Android多媒体、图形与定位系统深度解析

Android操作系统凭借其开放性和强大的功能生态,在移动设备领域占据主导地位。其核心技术支柱——多媒体框架、图形渲染系统和导航定位服务——共同构建了用户丰富多彩的交互体验。本文将对这三大部分进行整体性剖析。

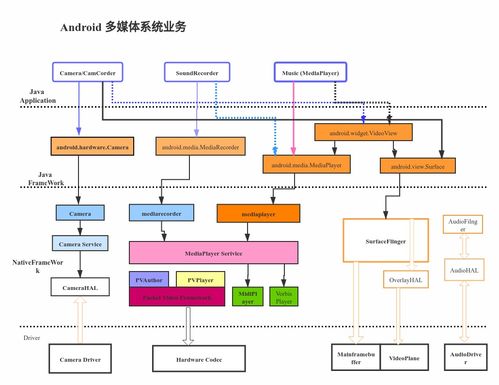

一、Android多媒体系统:从采集到播放的完整管道

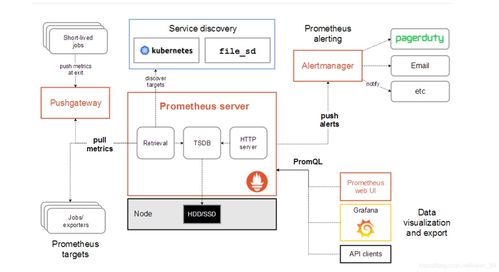

Android多媒体系统的核心是多媒体框架(Media Framework),它建立在Linux内核之上,为音频、视频的播放、录制、编解码提供了统一接口。

1. 核心架构分层:

- 应用层(App Layer): 开发者通过MediaPlayer、MediaRecorder、Camera2 API等高级API进行调用。

- Java框架层(Java Framework Layer): 提供管理多媒体生命周期、权限控制、格式协商的Java类。

- 原生层(Native Layer / C++ Framework): 这是系统的核心,包含Stagefright(现已演进为MediaCodec为中心的架构)和OpenMAX AL兼容层,负责实际的编解码和播放引擎。

- 硬件抽象层(HAL): 定义与芯片厂商(如高通、联发科)硬件编解码器、摄像头、音频DSP交互的标准接口,实现软硬件解耦。

- Linux内核层: 提供基础的音频ALSA驱动、视频V4L2驱动、内存管理等服务。

2. 关键组件与流程:

- MediaCodec: 是进行低层级编解码的基石。应用提供原始数据(如YUV视频帧、PCM音频),MediaCodec调用底层编解码器(可能是软件实现,更常见的是通过HAL调用硬件加速的Codec)进行处理。

- MediaExtractor: 负责解复用(Demux),从容器格式(如MP4、MKV)中分离出音频轨、视频轨和元数据。

- 音频管理(AudioFlinger & AudioPolicyService):

AudioFlinger是Android的音频服务器,混音所有应用的音频流并输出到硬件;AudioPolicyService则管理音频路由策略(如插入耳机时切换输出设备)。

- 相机流水线(Camera Pipeline): 现代Camera2 API提供了更精细的控制,图像数据从传感器经ISP处理,可通过

Surface直接送入MediaCodec编码或TextureView预览。

运作流程示例(视频播放): 应用调用MediaPlayer → 框架层创建MediaExtractor解析文件 → 通过MediaCodec初始化对应解码器 → 解码后的数据送入SurfaceFlinger或AudioFlinger进行渲染/播放。

二、Android图形系统:绘制与合成的艺术

Android图形系统的目标是高效、流畅地将应用的界面绘制到屏幕上。其核心是基于Buffer的生产者-消费者模型。

1. 核心架构与组件:

- 应用渲染(App Rendering):

- Canvas / View System: 传统的2D绘制API,适用于UI控件。

- OpenGL ES / Vulkan: 用于高性能2D/3D图形渲染,游戏和高级图形应用主要使用此路径。应用将内容绘制到

Surface提供的图形缓冲区(GraphicBuffer)中。

- 系统合成(System Composition):

- SurfaceFlinger: 系统的“合成器”。它接收来自各个应用窗口(每个窗口对应一个

Surface)的已绘制好的图形缓冲区,根据Z-order、透明度、位置等信息,将它们混合(Compose)成一个最终的帧缓冲区。

- Hardware Composer(HWC): HAL层组件,是图形性能的关键。它尝试让

SurfaceFlinger将合成工作委托给专门的硬件(如GPU或显示处理器DPU)来完成,以极大降低功耗并提高效率。只有HWC无法处理的复杂图层(如带OpenGL ES特效的),才会回退到SurfaceFlinger用GPU进行混合。

- 显示管理(Display Management):

- FrameBuffer / Display Driver: 内核层驱动,最终将HWC或

SurfaceFlinger提供的最终帧数据发送到物理显示屏。

2. “多图”与流畅性的保障:

- 双缓冲与三重缓冲: 应用通常使用双缓冲(一个前台Buffer用于显示,一个后台Buffer用于绘制)来避免撕裂。系统层面可能有更多缓冲区队列来平滑帧率波动。

- VSync(垂直同步)信号: 整个图形管道由VSync信号驱动。它协调应用绘制、

SurfaceFlinger合成与屏幕刷新的节奏,是Project Butter(黄油计划)引入的核心机制,旨在减少卡顿和撕裂。

- RenderThread: 自Android 5.0起,将UI线程的绘制工作(特别是

Canvas操作)剥离到独立的渲染线程,避免主线程阻塞,提升响应速度。

三、Android导航定位系统:感知世界的坐标

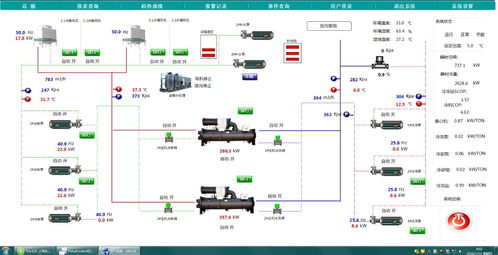

Android定位系统融合了多种信号源,以提供精确、快速、低功耗的位置服务。

1. 位置信息源(Provider):

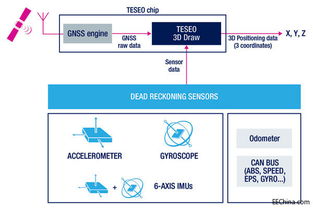

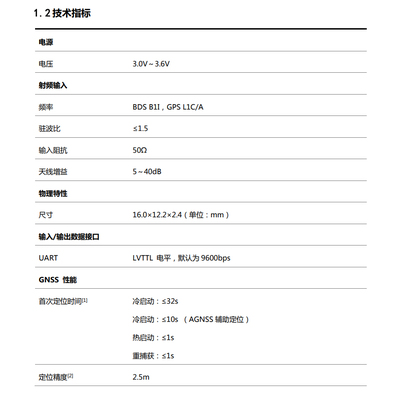

- GNSS(全球导航卫星系统): 最精确的源,包括美国的GPS、中国的北斗、欧盟的伽利略等。通过LocationManager.GPS_PROVIDER访问。

- 网络定位(Network Provider): 利用蜂窝基站三角测量和Wi-Fi MAC地址数据库(如Google的位置服务)进行定位。精度较低但速度快、室内可用、耗电少。通过

LocationManager.NETWORK_PROVIDER访问。

- 传感器辅助(Sensor Assistance): 使用加速度计、陀螺仪、磁力计进行惯性导航(Dead Reckoning),在GNSS信号短暂丢失时(如隧道中)提供连续的位置推算。

2. 系统架构与运作流程:

- 应用层: 应用通过LocationManager API或更高层的Fused Location Provider API(Google Play服务的一部分)请求位置更新。

- 位置服务(Location Services): 系统服务,管理所有位置请求,进行权限控制,并选择合适的定位源。

- 定位提供商(Location Providers): 实际的GNSS芯片驱动、网络定位服务等。GNSS芯片通过串口或USB与主机通信,驱动层通常遵循NMEA 0183标准协议输出原始数据。

- 融合定位(Fused Location Provider, FLP): 这是Android定位的“智能大脑”。它并不直接提供定位信号,而是作为一个传感器融合引擎,根据应用的需求(如对精度、功耗、速度的要求),智能地融合来自GNSS、网络、传感器的所有数据,计算出最优的、平滑的位置估计。它能自动处理信号切换,是开发者推荐使用的API。

3. 运作流程示例: 导航应用请求高精度位置 → FLP接收到请求 → 同时启动GNSS芯片搜索卫星、查询网络位置、并监听传感器 → 对多源数据进行滤波和融合(常用卡尔曼滤波等算法) → 输出一个精度高且连续的位置流给导航应用 → 应用结合地图数据实现导航和路径规划。

协同工作的智能平台

Android的这三大系统并非孤立运作,而是深度协同:

- 导航与多媒体的结合: 行车导航时,地图图形(图形系统)与语音播报(多媒体音频)同步进行。

- 相机与图形的结合: 拍照预览时,相机数据直接通过

Surface送入图形管线显示;AR应用更是需要将相机画面(多媒体)与3D图形叠加(图形系统),并依赖精确定位(定位系统)。 - 系统级的优化: 当检测到用户在进行高精度导航(高功耗)时,系统可能会适度调整后台多媒体任务的资源分配,以平衡性能与续航。

理解这些底层系统的运作原理,有助于开发者优化应用性能,为用户打造更流畅、更智能的移动体验。

如若转载,请注明出处:http://www.wmwulian.com/product/17.html

更新时间:2026-05-06 02:46:51